#1 보안 프로그래밍 교육 기업

人工智能软件供应链问题

AI 扩展了您的软件供应链

AI 编码助手、LLM 和 MCP 连接的代理现在可以在您的存储库中生成生产代码。发展速度加快了——但治理没有跟上步伐。人工智能已成为您软件供应链中不受控制的贡献者。

大多数组织无法明确回答:

- 哪些 AI 模型生成了特定的提交

- 这些模型是否持续产生安全的输出

- 哪些 MCP 服务器处于活动状态及其访问的内容

- 人工智能辅助提交是否符合安全编码标准

- 人工智能的使用如何影响整体软件风险

真正的人工智能软件治理需要:

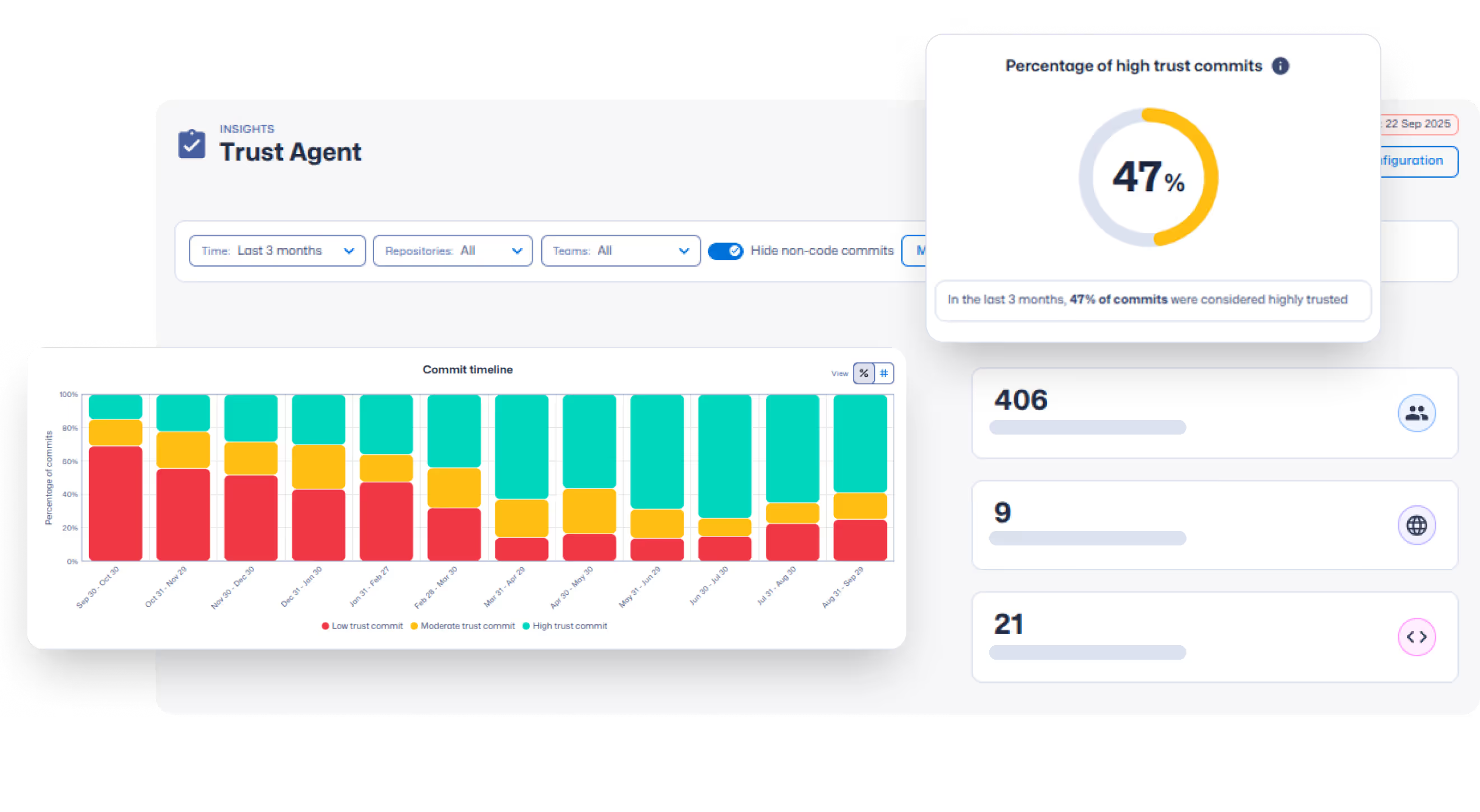

跨存储库的 AI 使用情况的可见性

委员会级别的风险关联和政策执行

可衡量的开发人员在人工和人工智能辅助工作流程中的能力

如果没有结构化的人工智能软件治理,组织将面临所有权分散、知名度有限以及 曝光率不断增加。 人工智能辅助开发提高了代码速度——但如果没有强制性的监督,它还会增加引入的漏洞风险和模型供应链的风险。

AI 소프트웨어 거버넌스란 무엇인가?

对人工智能驱动的开发进行强制监督

它使组织能够:

- 深入了解人工智能的使用地点和方式

- 将 AI 辅助提交与软件风险相关联

- 在提交时定义和执行 AI 使用政策

- 加强对人类和人工智能辅助开发的问责制

为什么 AI 软件治理很重要

AI 加速开发。

AI 扩展了您的软件供应链。

人工智能引入了模型风险和问责差距。

人工智能治理必须是可衡量的、可执行的和可审计的。

핵심 역량

管理 AI 软件生命周期

传统的应用程序安全工具会在编写代码后检测漏洞。人工智能软件治理强制执行政策,验证 AI 模型的使用情况,并关联风险——在漏洞投入生产之前将其防范。

AI 도구 및 모델의 추적 가능성

了解 AI 在何处影响代码

了解哪些 AI 工具和模型会影响存储库中的代码,从而创建可验证的 AI 使用情况清单。

阴影 AI 检测

揭露未经授权的 AI 使用

识别在批准的治理控制之外运行的未经授权的 AI 工具和模型。

LLM 안전성 벤치마킹

安全至上的型号选择

根据实际漏洞模式评估 AI 模型的性能,并强制使用经批准的模型。

위원회 수준의 위험 점수 및 거버넌스

生产前防范风险

将 AI 辅助提交与风险信号关联起来,并在代码投入生产之前应用可执行的政策。

MCP 服务器可见性

安全的 AI 代理供应链

识别正在使用的 MCP 服务器,并对未经批准的连接执行提交级别的策略。

개발자 발견 및 정보

消灭影子贡献者

持续识别开发者、人工智能辅助活动和提交模式,以加强问责制和风险可见性。

이건 누구에게 주는 거야?

我们服务的受众

Lorem Issum diam quis eim leboutis ein selerisque lobortis sepitis beelrisque lobortis sepitis celerisque lobortis celeriskue filmentis celeriskue filmentis celeriskue diam

在人工智能驱动的开发发布之前对其进行管理

跟踪 AI 模型的使用情况。在提交时强制执行政策。保持对人工智能软件供应链的审核就绪控制。

AI 软件治理平台常见问题解答

控制、测量和保护 AI 辅助软件开发

了解 Secure Code Warrior 如何在 AI 辅助开发工作流程中提供 AI 可观察性、策略执行和治理。