AI는 소프트웨어 공급망을 확장했습니다

AI 코딩 어시스턴트, LLM 및 MCP 연결 에이전트는 이제 리포지토리 전체에서 프로덕션 코드를 생성합니다.개발 속도는 빨라졌지만 거버넌스는 그 속도를 따라가지 못했습니다.AI는 소프트웨어 공급망에서 통제되지 않는 기여자가 되었습니다.

대부분의 조직은 다음과 같은 질문에 명확하게 답하지 못합니다.

- 특정 커밋을 생성한 AI 모델은?

- 이러한 모델이 지속적으로 안전한 출력을 생성하는지 여부

- 활성 상태인 MCP 서버 및 액세스 대상

- AI 지원 커밋이 보안 코딩 표준을 충족하는지 여부

- AI 사용이 전체 소프트웨어 위험에 미치는 영향

구조화된 AI 소프트웨어 거버넌스가 없으면 조직은 소유권이 분열되고 가시성이 제한되며 노출 증가. AI 지원 개발은 코드 속도를 향상시키지만 강제적인 감독이 없으면 취약성 위험과 모델 공급망 노출도 증가합니다.

AI 기반 개발에 대한 시행 가능한 감독

이를 통해 조직은 다음을 수행할 수 있습니다.

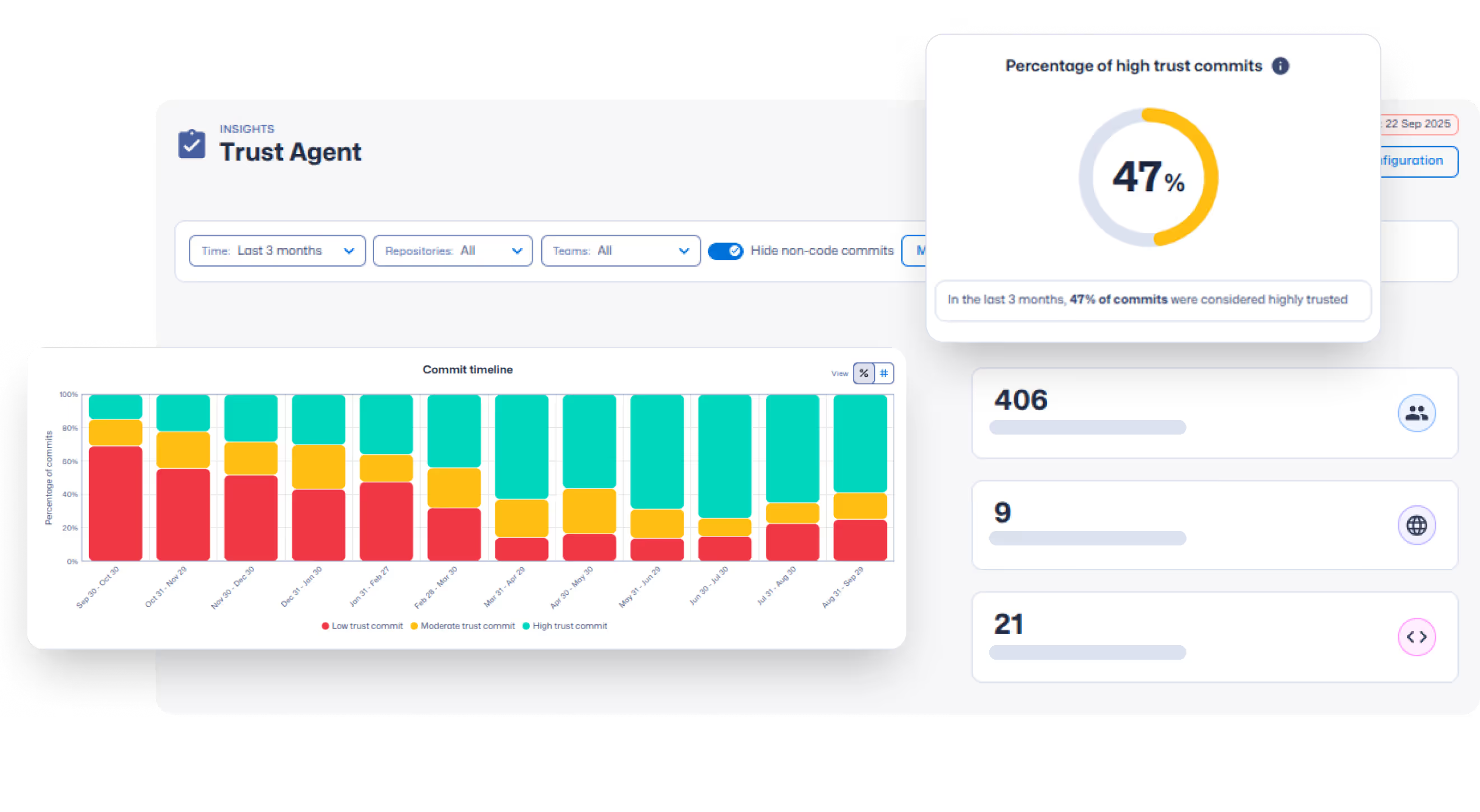

- AI가 어디에 어떻게 사용되는지에 대한 가시성 확보

- AI 지원 커밋과 소프트웨어 위험의 상관관계 파악

- 커밋 시 AI 사용 정책 정의 및 적용

- 인간 및 AI 지원 개발 전반의 책임 강화

AI 소프트웨어 라이프사이클 관리

기존 애플리케이션 보안 툴은 코드 작성 후 취약점을 탐지합니다.AI 소프트웨어 거버넌스는 정책을 시행하고, AI 모델 사용을 검증하고, 커밋 시 위험의 상관 관계를 분석하여 도입된 취약성이 프로덕션에 도달하기 전에 이를 방지합니다.

AI 도구 및 모델 추적성

리포지토리 전반에서 어떤 AI 도구 및 모델이 코드에 영향을 미치는지에 대한 가시성을 확보하여 검증 가능한 AI 사용 인벤토리를 생성합니다.

섀도우 AI 감지

승인된 거버넌스 제어 외부에서 작동하는 승인되지 않은 AI 도구 및 모델을 식별합니다.

LLM 보안 벤치마킹

실제 취약성 패턴을 기준으로 AI 모델 성능을 평가하고 승인된 모델을 의무화합니다.

커밋 수준의 위험 평가 및 거버넌스

AI 지원 커밋을 위험 신호와 연관시키고 코드가 프로덕션에 도달하기 전에 실행 가능한 정책을 적용하세요.

MCP 서버 가시성

사용 중인 MCP 서버를 식별하고 승인되지 않은 연결에 대해 커밋 수준 정책을 적용합니다.

개발자 디스커버리 및 인텔리전스

개발자, AI 지원 활동 및 커밋 패턴을 지속적으로 식별하여 책임과 위험 가시성을 강화합니다.

우리가 서비스하는 청중

우리는 이 방법을 잘 알고 있습니다. 우리는 이 두 가지 축복을 골고루 살기 위해 노력하고 있습니다.

출시하기 전에 AI 기반 개발을 관리하세요

AI 모델 사용을 추적합니다.커밋 시 정책을 적용합니다.AI 소프트웨어 공급망에 대한 감사에 대비한 제어를 유지하세요.

AI 지원 소프트웨어 개발의 제어, 측정 및 보안

Secure Code Warrior가 AI 지원 개발 워크플로우 전반에서 AI 관찰 가능성, 정책 적용 및 거버넌스를 어떻게 제공하는지 알아보십시오.