Codage sécurisé pour le développement de l'IA et les codeurs Vibe

Codage sécurisé pour le développement de l'IA et les codeurs Vibe

Tirez parti des gains de productivité et de l'innovation liés au codage basé sur l'IA sans augmenter de façon exponentielle le risque de bogues cachés, de failles de sécurité et de dettes techniques.

Améliorer les compétences en matière de développement sécurisé dans le nouveau monde de l'IA

Secure Code Warrior aide les entreprises à passer à des pratiques de développement assistées par l'IA grâce à des initiatives de renforcement des compétences hautement pertinentes conçues pour combler des lacunes telles que le manque de sensibilisation à l'utilisation de l'IA et des LLM, l'excès de confiance dans la sécurité du code généré par l'IA et l'émergence de nouvelles vulnérabilités associées au codage de l'IA.

Accédez à un contenu de premier ordre couvrant des sujets liés à l'IA et au LLM pour divers rôles au sein du SDLC afin d'atténuer les risques. Des développeurs à l'assurance qualité en passant par les architectes et les chefs de produit, nous avons ce qu'il vous faut.

Développement de logiciels sécurisés de nouvelle génération

Atténuer les risques dans un monde d'IA et de développeurs

Un plus grand nombre de lignes de code étant produites plus rapidement et avec moins de minutie, le risque de bogues cachés, de failles de sécurité et de dette technique augmente de façon exponentielle. Cette évolution rend la révision du code, les tests et les pratiques de codage sécurisées plus critiques que jamais, garantissant que la rapidité ne se fasse pas au détriment de la fiabilité et de la sécurité. Le renforcement des compétences des développeurs est la première étape pour obtenir de meilleurs résultats dans un environnement où des outils tels que Github Copilot, Cursor AI, Amazon Q developer et d'autres sont utilisés et souligne la nécessité de continuer à mettre l'accent sur l'enseignement du code sécurisé.

Découvrez le contenu de la plateforme d'apprentissage

Gérez les risques liés à l'IA grâce à l'observabilité et à la gouvernance

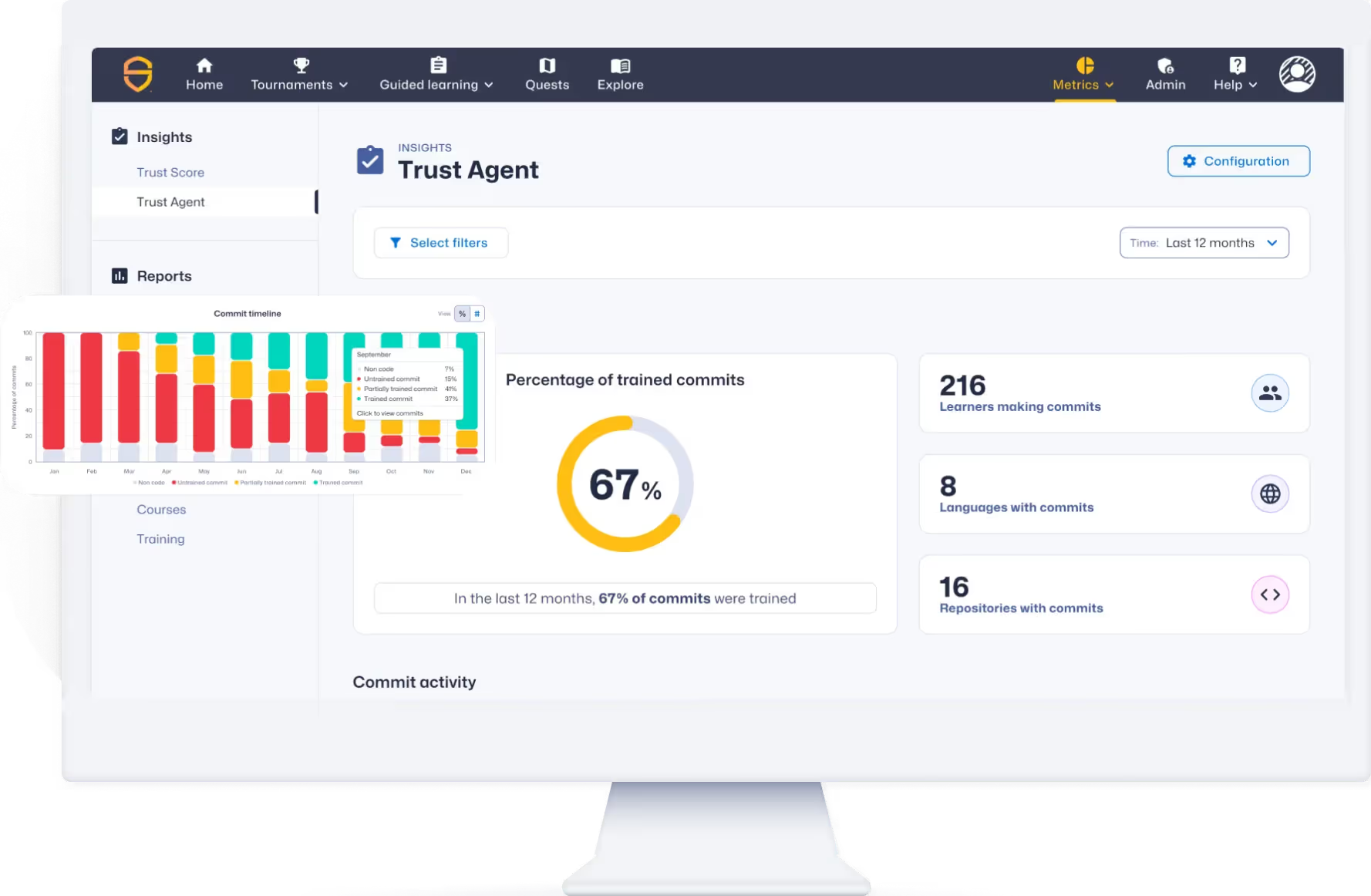

Les initiatives en matière de compétences ne sont que la première étape pour vous assurer de faire face aux risques supplémentaires liés au codage assisté par l'IA. SCW Trust Agent™ vous donne une visibilité sur les développeurs qui travaillent avec votre base de code et un aperçu de leurs compétences en matière de sécurité. Vous pouvez ensuite configurer des politiques pour les référentiels de code afin d'améliorer votre niveau de sécurité grâce à une gouvernance proactive.

Découvrez SCW Trust AgentUn impact mesurable au-delà de la conformité

Les organisations qui adoptent une approche proactive pour sécuriser les meilleures pratiques en matière de code qui vont au-delà de la conformité obtiennent des résultats commerciaux tangibles. Parce que le moyen le plus rentable de remédier aux vulnérabilités est de les prévenir dès le départ. Score de confiance SCW™ fournit aux entreprises un moyen de mesurer et de comparer les progrès des compétences des développeurs en matière de sécurité au fil du temps, qu'il est particulièrement important de suivre en cas d'adoption précoce d'environnements de codage pilotés par l'IA.

Découvrez le score de confiance SCW

Guidez une génération de code IA plus sûre grâce à des règles de sécurité gratuites

Les outils de codage IA sont rapides, mais pas toujours sécurisés. Les règles de sécurité de l'IA gratuites de Secure Code Warrior offrent des garde-fous simples et légers pour aider des outils tels que Copilot et Cursor à générer un code plus sûr par défaut. Facile à adopter, à étendre et à intégrer à votre configuration, aucun compte SCW n'est nécessaire.

Découvrez les règles de sécurité de l'IAAméliorer la productivité, mais augmenter les risques

L'adoption généralisée des outils de codage basés sur l'IA pose un nouveau défi : le manque de visibilité et de gouvernance du code généré par l'IA.

78 %

- StackOverflow

30 %

- Archive IV

50 %

- Banquette BAX

Les avantages de Trust Agent : AI

Les nouvelles fonctionnalités d'IA de SCW Trust Agent offrent l'observabilité et le contrôle approfondis dont vous avez besoin pour gérer en toute confiance l'adoption de l'IA dans votre cycle de vie de développement logiciel sécurisé (SDLC) sans sacrifier la sécurité.

Le défi de l'IA dans votre SDLC

Sans moyen de gérer l'utilisation de l'IA, les responsables de la sécurité informatique, de la sécurité des applications et de l'ingénierie sont exposés à de nouveaux risques et à de nouvelles questions auxquelles ils ne peuvent répondre. Voici quelques préoccupations, notamment : le manque de visibilité sur les développeurs qui utilisent quels modèles non approuvés. L'incertitude quant aux compétences en matière de sécurité des développeurs utilisant l'IA. Aucune idée du pourcentage du code contribué est généré par l'IA. Incapacité à appliquer des politiques et une gouvernance pour gérer les risques liés aux outils d'IA.

- Manque de visibilité sur les développeurs qui utilisent quels modèles non approuvés.

- Incertitude quant aux compétences en matière de sécurité des développeurs utilisant l'IA.

- Aucune idée du pourcentage du code de contribution généré par l'IA

- Incapacité à appliquer la politique et la gouvernance pour gérer les risques liés aux outils d'IA.

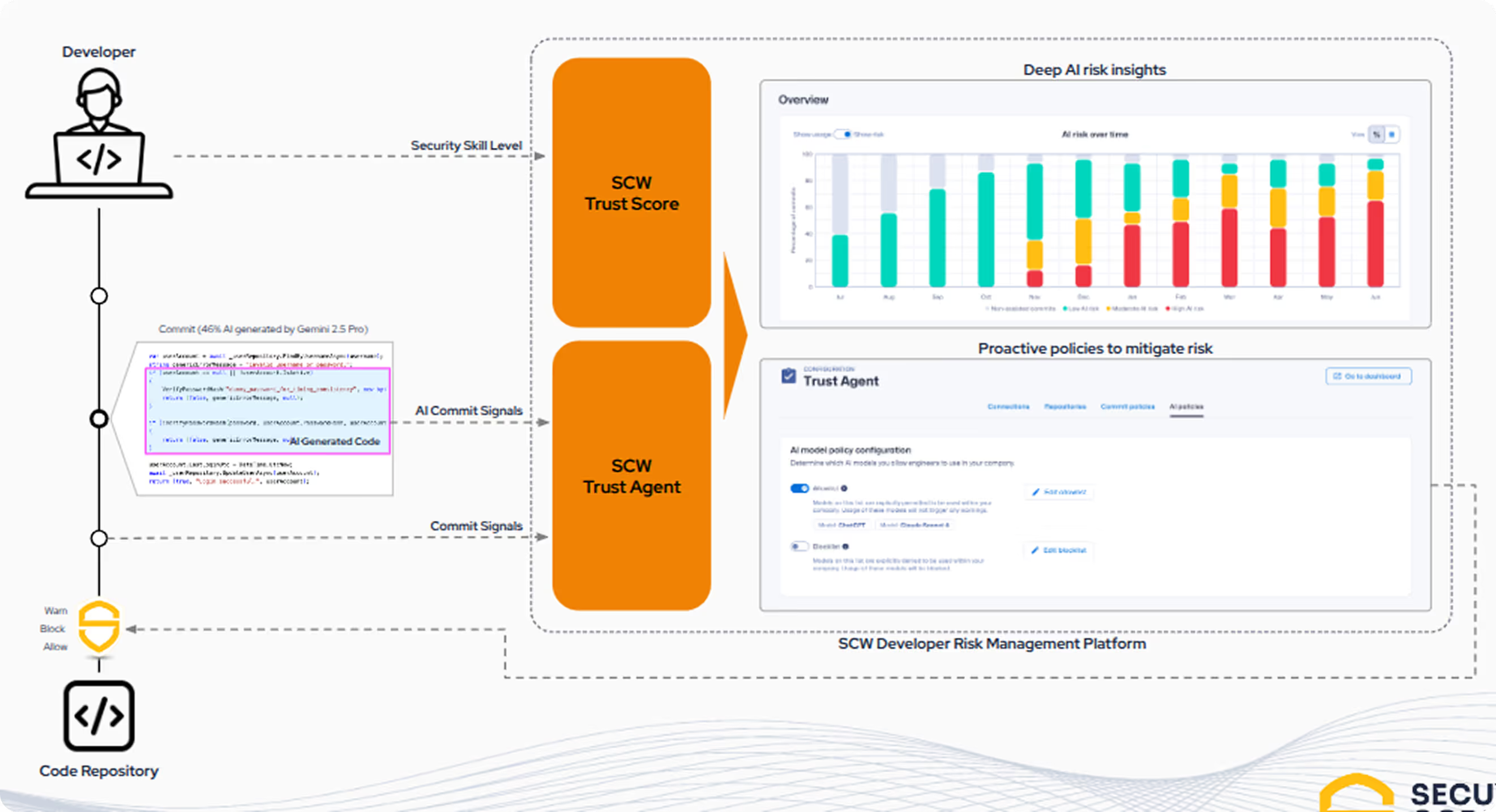

Une combinaison unique de signaux

SCW permet aux entreprises de profiter de la rapidité du développement piloté par l'IA sans sacrifier la sécurité. AI Signals est la première solution à fournir visibilité et gouvernance en corrélant une combinaison unique de trois signaux clés pour comprendre le risque des développeurs assistés par l'IA au niveau de la validation.

- Utilisation de l'outil de codage AI : Des informations sur qui utilise quels outils d'IA, quels modèles LLM sur quelle base de code.

- Capturé en temps réel : Agent de confiance : l'IA intercepte le code généré par l'IA sur l'ordinateur et l'IDE du développeur.

- Compétences des développeurs en matière de codage sécurisé : Nous fournissons une compréhension claire des compétences d'un développeur en matière de codage sécurisé, qui est la compétence fondamentale requise pour utiliser l'IA de manière responsable.

AI 활용의 가시성

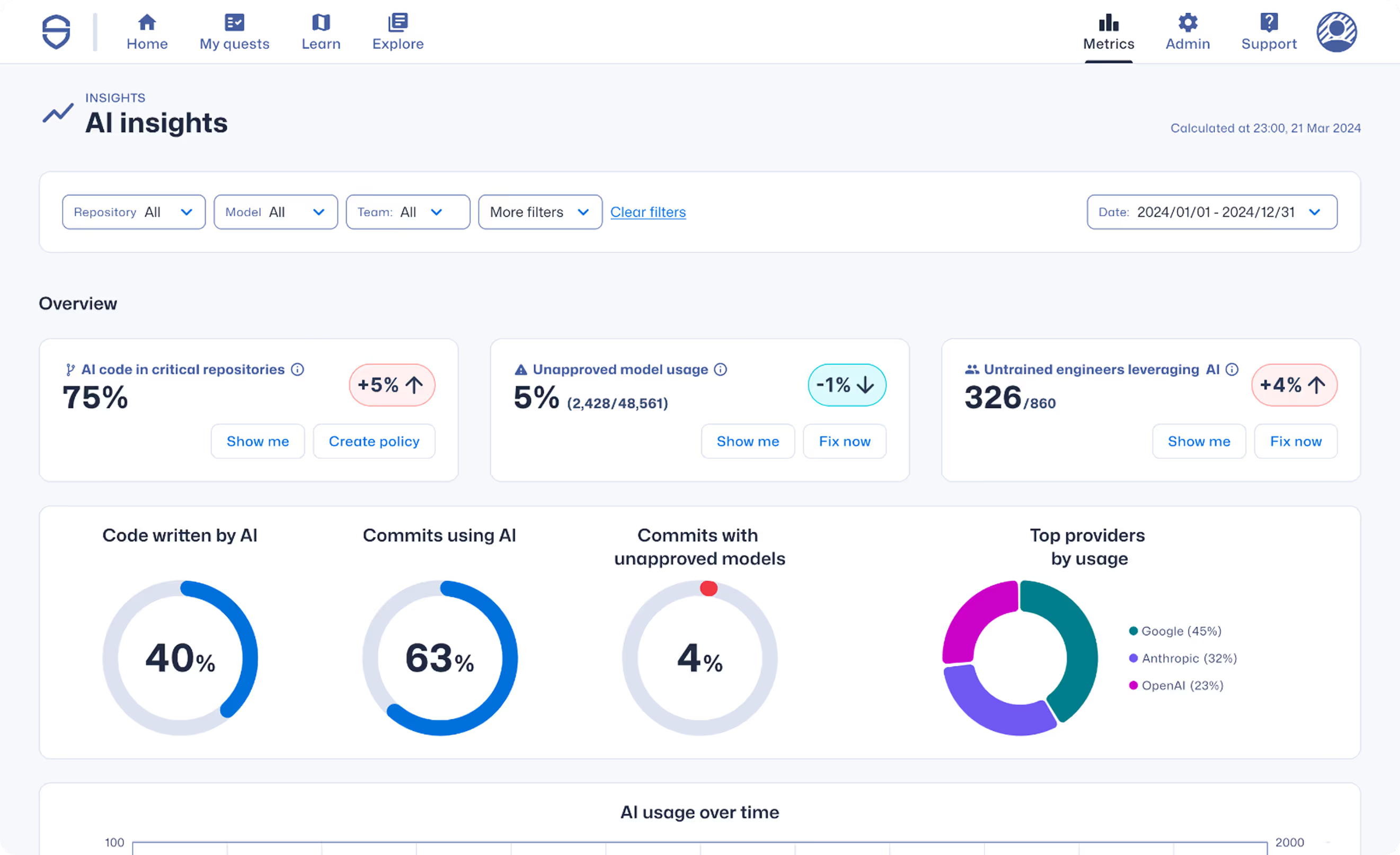

Obtenez une vue d'ensemble des assistants et agents de codage basés sur l'IA, ainsi que des LLM qui les alimentent. Découvrez des outils et des modèles non approuvés. Plus d' « IA fantôme ».

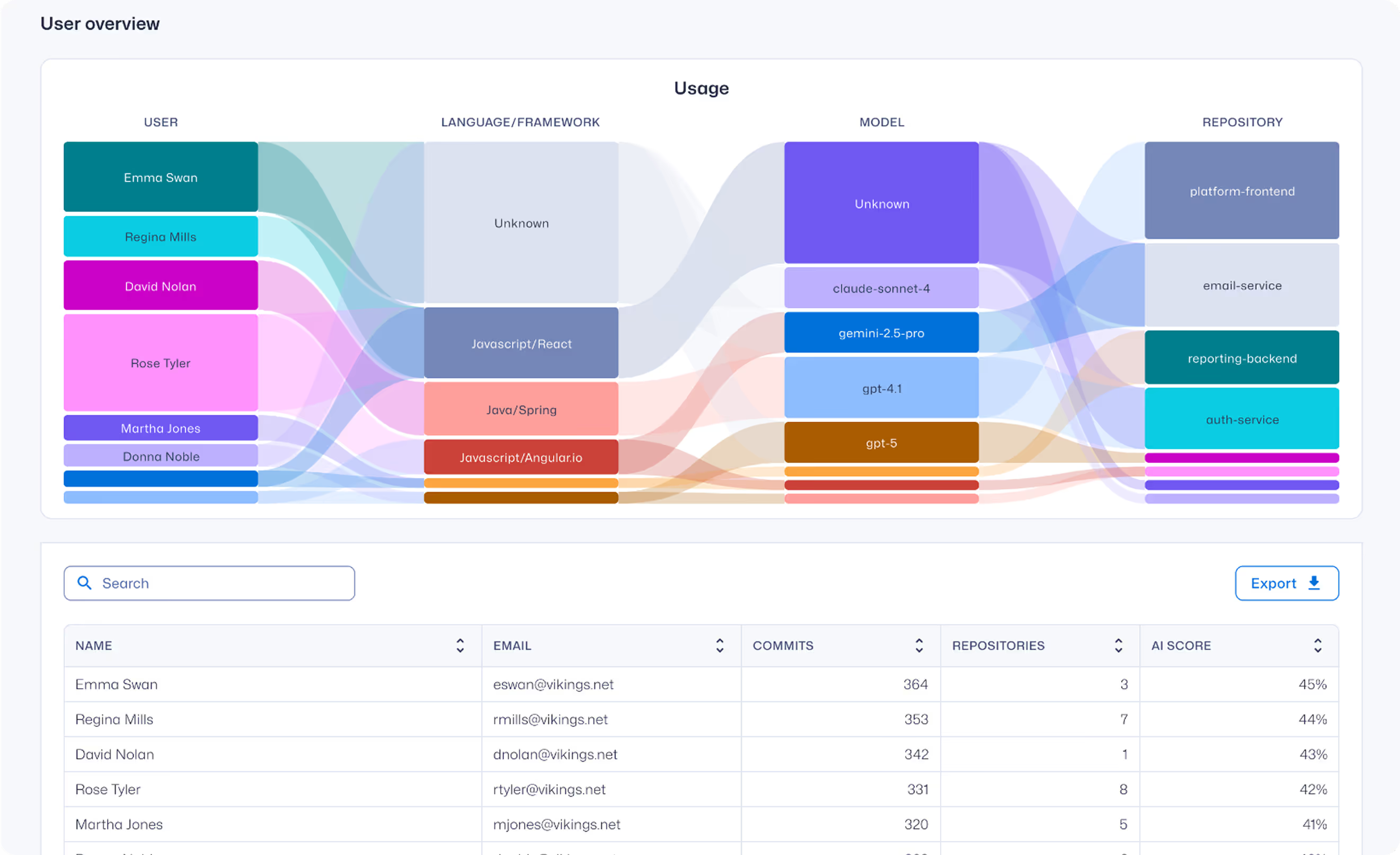

Observabilité des commits assistés par l'IA par le développeur et la base de code

Bénéficiez d'une visibilité approfondie sur le développement de logiciels assisté par l'IA, notamment sur les développeurs qui utilisent quels modèles LLM et sur quelles bases de code.

Gouvernance et contrôle intégrés

Connectez le code généré par l'IA aux validations réelles pour comprendre le véritable risque de sécurité introduit. Automatisez l'application des politiques pour garantir que les développeurs utilisant l'IA respectent les normes de codage sécurisées avant que leurs contributions ne soient acceptées.

Découvrez AI Insights

Agent de confiance : l'IA donne aux entreprises une visibilité sur les risques présentés par les développeurs à l'aide d'outils de génération de code soutenus par LLM. Pour ce faire, la solution se déroule en trois étapes :

- Inspectez le trafic de code généré par l'IA : Trust Agent : l'IA est déployée sous la forme d'un simple plugin IDE ou d'un agent de point final qui intercepte et surveille le code généré par les outils de codage d'IA, tels que GitHub Copilot, ChatGPT, Google Gemini ou Cursor.

- Enrichissez avec le niveau de compétence du développeur : La dernière étape consiste à enrichir ces données grâce aux compétences de codage sécurisé du développeur contributeur, telles que mesurées par le produit leader du secteur Secure Code Learning de SCW.

En corrélant ces signaux clés, Trust Agent : AI fournit des informations exploitables aux équipes de sécurité et d'ingénierie, notamment l'utilisation non autorisée du modèle LLM et l'identification des développeurs ayant des connaissances limitées en matière de codage sécurisé qui commettent du code généré par l'IA.

Points forts concernant le codage généré par l'IA

AI 코딩이 개발자의 비판적 사고에 어떤 영향을 미쳤나요?

AI 지원 개발은 코딩 속도를 획기적으로 향상시켜 코드 작성량을 급증시킵니다. 이제 개발자는 전체 함수, 모듈 또는 애플리케이션을 단 몇 초 만에 생성할 수 있어 전체 개발 시간이 단축되지만, 이러한 생산성 향상은 새로운 과제를 야기합니다.

연구에 따르면 사람들은 AI가 생성한 답을 당연한 것으로 받아들여 정답에 도달하기 위한 비판적 사고 과정을 생략하는 것으로 나타났습니다.

"바이브 코딩"이란 무엇인가요?

AI는 최근 "바이브 코딩"이라고 불리는 보다 유동적이고 직관적인 워크플로우를 가능하게 합니다. 개발자는 구문보다는 높은 수준의 의도에 집중할 수 있습니다.

AI를 사용하면서 소프트웨어 개발은 어떻게 변화했나요?

최신 소프트웨어 개발자들은 생산성을 높이고 반복적인 작업을 줄이며 코드 품질을 개선하기 위해 Cursor AI, Windsurf, Amazon Q Developer, GitHub Copilot과 같은 AI 기반 코딩 어시스턴트를 점점 더 많이 활용하고 있습니다. 이러한 도구는 지능형 쌍 프로그래머 역할을 하며 코드 제안과 버그 수정을 제공합니다. 소프트웨어 제작은 점점 더 역동적이고 창의적으로 변하고 있으며, 개발자의 기술도 그에 맞춰 진화해야 합니다.

%2520%2520(3).avif)