인공지능은 코드를 작성할 수 있지만, 기술이 그것을 보장한다.

당사의 기업용 보안 코딩 플랫폼은 인간과 AI가 생성한 코드를 보호하는 데 필요한 역량을 개발하며, 동시에 배포 속도를 저하시키지 않습니다.

La formación tradicional en seguridad se centra en — no capacidad. El análisis estático detecta los problemas una vez que se presentan. Reducir el riesgo del software requiere mejorar el comportamiento de codificación segura La capacidad de codificación segura es la base de una gobernanza eficaz del software de IA.

Build developer capability for secure AI development

Secure Code Warrior Learning provides AI security training that builds the skills behind every commit. Developers learn to secure AI-generated code through hands-on practice across real-world AI workflows, reducing risk at the source.

안전한 코딩 역량을 대규모로 개발하십시오

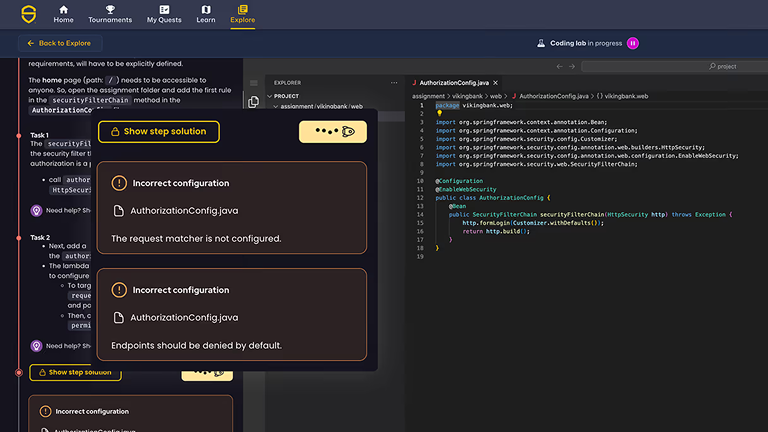

안전하고 실용적인 암호화 연구실

개발자들은 75개 이상의 언어와 프레임워크에서 대화형 연습을 통해 실제 취약점을 해결합니다.

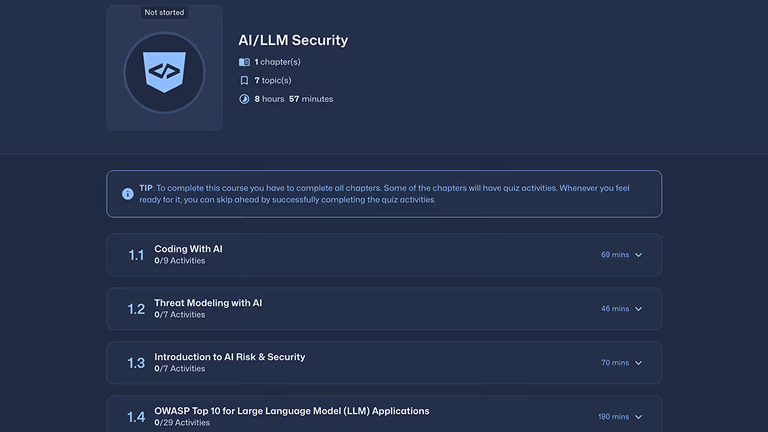

인공지능 전용 보안 모듈

AI가 생성한 코드를 검증하고 보호하며, 안전하지 않은 패턴을 탐지하고 AI 지원 워크플로우에 안전한 표준을 적용하십시오.

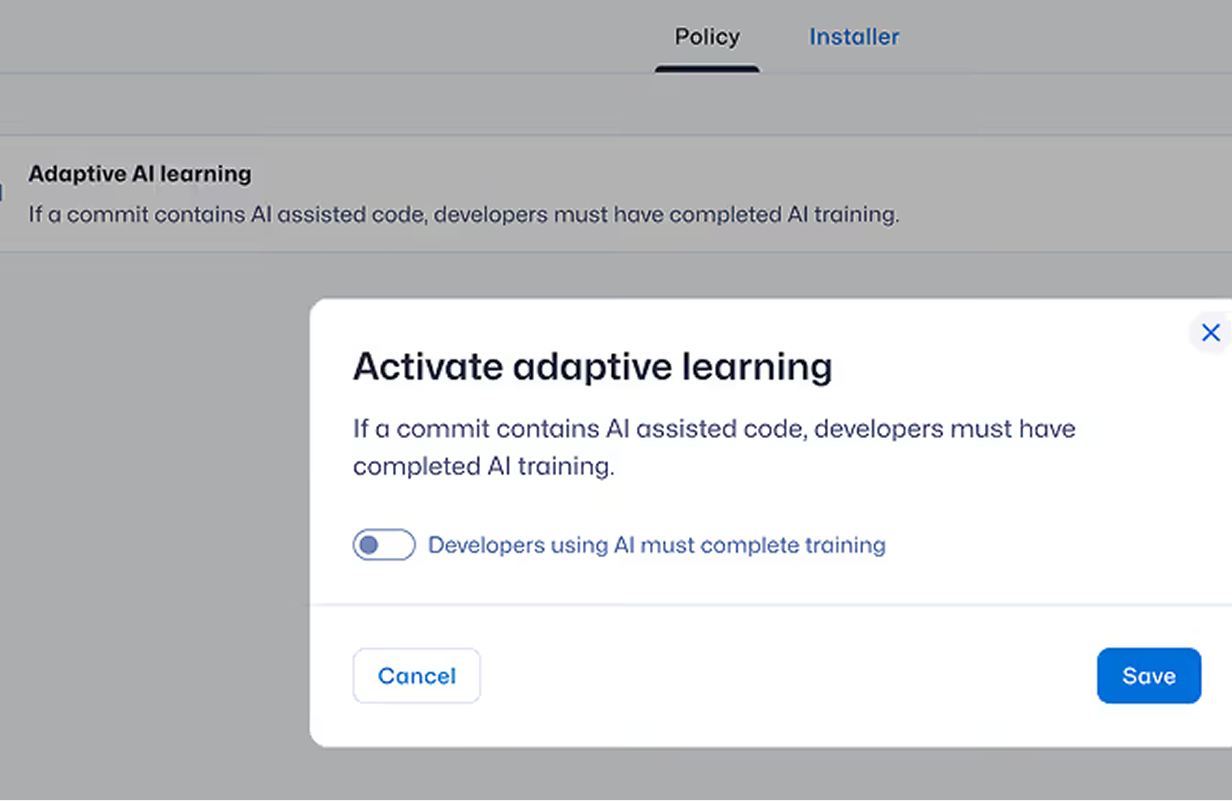

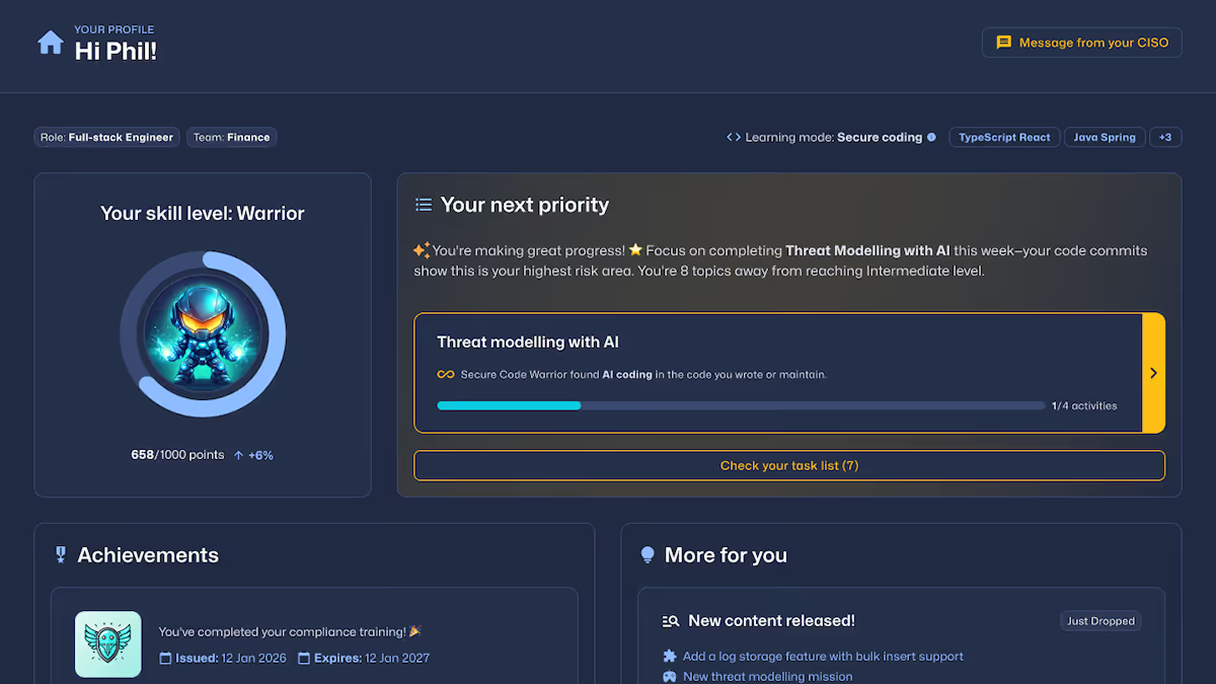

적응형 학습 경로

개발자의 행동에 따라 특정 교육을 자동으로 할당하고, 위험 신호를 확인하거나 격차를 비교하세요.

진행 상황을 측정합니다

개발자의 역량을 평가하고, 동료 개발자와 비교하며, SCW Trust Score®를 통해 안전한 코딩의 측정 가능한 진척도를 추적하세요.

준수 달성

OWASP, NIST, PCI DSS, CRA 및 NIS2의 주요 10개 항목에 맞춰 교육을 구성하고 감사 준비가 완료된 보고서를 제공합니다.

El plano de control para el desarrollo impulsado por la IA

Haga que el desarrollo impulsado por la IA sea visible, seguro y resiliente, evitando las vulnerabilidades antes de la producción para que los equipos puedan avanzar con rapidez y confianza.

퀘스트

코딩 실습

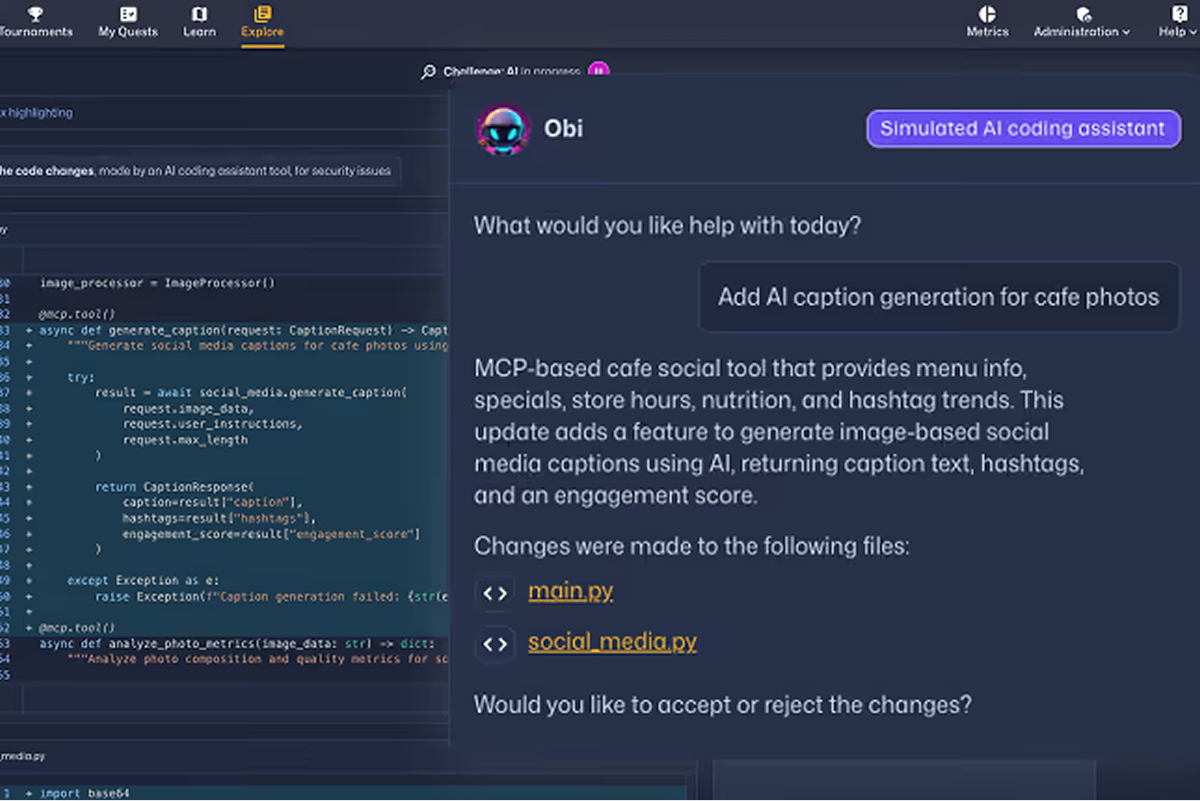

AI Challenges

Check out the SCW Learning Content Guide which outlines the breadth and depth of training available across the Secure Code Warrior platform, including secure coding vulnerabilities, AI security topics, programming languages, frameworks, and role-based learning paths.

Missions

취약점을 근원에서 줄이십시오

Secure Code Warrior 반복적인 취약점을 줄이고, 안전한 코딩 습관을 강화하며, 개발자들에게 눈에 띄는 개선 효과를 보여줍니다. 이러한 결과는 현대 개발 환경에서 대규모 기업 대상 보안 코딩 교육의 측정 가능한 영향을 입증합니다.

시간에 해결하는 것이 더 빠릅니다

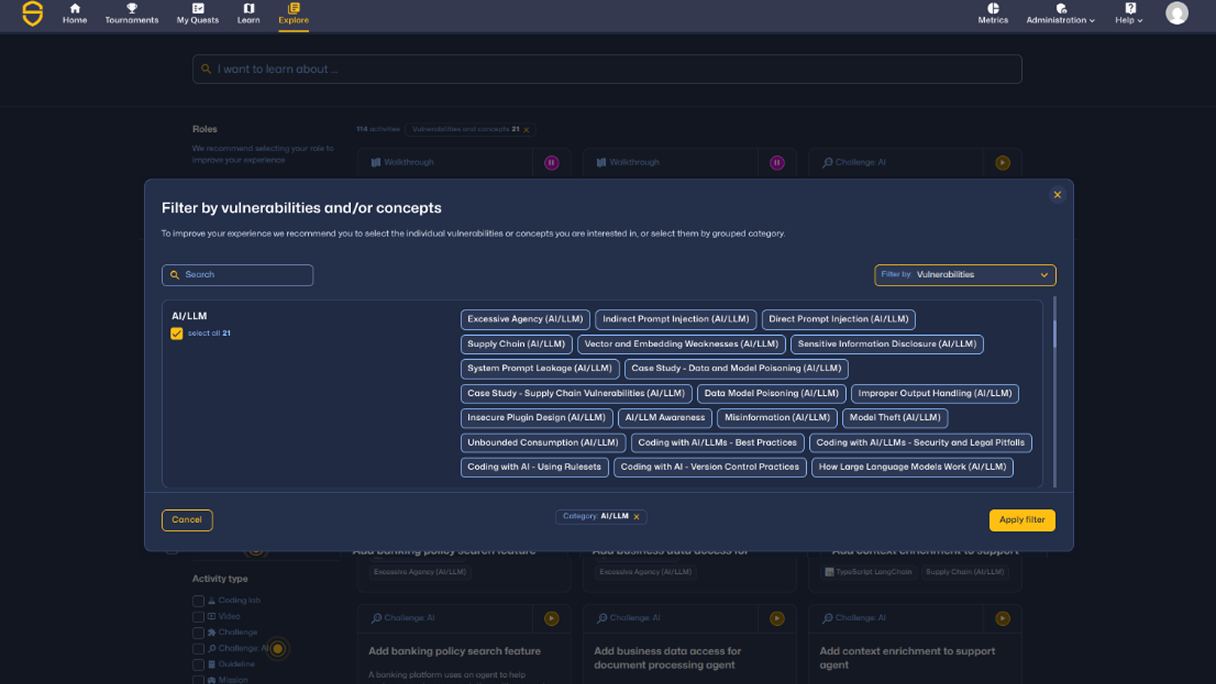

What developers learn in AI security training

Coverage spans LLM vulnerabilities, agent protocols, infrastructure security, and foundational AI security design — mapped to real developer workflows.

Practice real-world AI and LLM security risks.

AI security training teaches developers how to identify, prevent, and remediate vulnerabilities in AI-generated code and modern AI systems, including:

Build foundational AI security knowledge

Developers learn how to securely design and review AI systems through:

Secure AI agents, protocols, and cloud AI environments

Understand and mitigate risks across agent-based systems and AI infrastructure, including MCP and cloud AI services:

Secure AI services and model integrations

Model Context Protocol — Secure AI agents and protocol interactions

인공지능 정부 기관을 위해 특별히 설계됨

개발자로서 측정 가능한 역량을 입증하고, 인간과 AI가 협업하는 개발 환경에서 소프트웨어 위험을 줄이십시오.

안전한 코드는 안전한 개발자로부터 시작됩니다

안전한 코딩 기술을 강화하고, 도입된 취약점을 줄이며, 조직 전체 개발자 간에 측정 가능한 신뢰를 구축하십시오.

실습을 통한 안전한 코딩 학습으로 취약점을 줄이세요

Secure Code Warrior 개발자의 보안 역량을 Secure Code Warrior 취약점을 줄이며 측정 가능한 위험 감소를 제공하는 방법을 알아보세요.